AI Deepfake : डीपफेक का नाम आपने जरूर सुना होगा। नहीं सुना है तो हम आपको बता रहे हैं कि डीपफेक दुनिया के लिए एक बड़ी समस्या बनता जा रहा है। अनेक विशेषज्ञ तो आम बोलचाल की भाषा में डीपफेक को एक लाईलाज बीमारी बता रहे हैं। भारत से लेकर पूरी दुनिया में डीपफेक का डर बढ़ता जा रहा है। भारत में लोकसभा के चुनाव के कारण डीपफेक का डर और अधिक बढ़ गया है। कहीं लोकसभा के चुनाव में भारी न पड़ जाए डीपफेक ? यह डर सभी को सता रहा है।

AI Deepfake

सभी को डरना जरूरी है डीपफेक से

जाने-माने पत्रकार राजीव कुमार ने अपने एक विश्लेषण में डीपफेक से डरने पर विस्तार से प्रकाश डाला है। आप भी समझ लें डीपफेक के डर का यह पूरा मामला राजीव कुमार लिखते हैं कि पिछले वर्ष सितंबर में स्लोवाकिया के आम चुनाव में प्रोग्रेसिव स्लोवाकिया पार्टी के नेता सिमेका इसलिए हार गए, क्योंकि चुनाव से ठीक दो दिन पहले उनका एक वीडियो इंटर मीडिया पर प्रसारित हो गया। उस वीडियो में वह कह रहे थे कि चुनाव जीतने पर बीयर की कीमत दोगुनी कर देंगे। वास्तव में सिमेका ने ऐसी कोई घोषणा नहीं की थी, बल्कि किसी ने डीपफेक का प्रयोग कर फर्जी वीडियो प्रसारित कर दिया। वीडियो का सच लोगों तक पहुंचता, इससे पहले नुकसान हो चुका था। यह घटना भले ही दूर देश की है, लेकिन डीपफेक का खतरा भारत में भी राजनीतिक दलों और नेताओं को डरा रहा है। ऐसे कई मामले यहां भी सामने आ चुके हैं। ऐसे में जानकारों की सलाह ‘यही है कि डीपफेक से बचके रहना… यह चुनाव में कहीं भारी न पड़ जाए !दरअसल, तकनीक के इस दौर में इंटरनेट, मोबाइल और इंटरनेट मीडिया ने नेताओं को चुनावी दौड़-धूप से कुछ हद तक बचाते हुए प्रचार-प्रसार केमाध्यम को गति दी है। वहीं, इसके अपने चुना की नुकसान भी हैं। अब तक तो फोटो या कै में वीडियो से छेड़छाड़ के ऐसे मामले ही का हा सामने आते रहे, जिनका फर्जीवाड़ा पैनी क ने निगाह से पकड़ लिया जाता था, लेकिन रहे आर्टिफिशियल इंटेलीजेंस (एआइ) ने के इ इस फर्जीवाड़े को भी इतना महीन रूप इ दे दिया है कि यह बिल्कुल वास्तविक जैसा ही लगता है। स्लोवाकिया की घटना यदि विदेश की बानगी है तो कुछ समय – पहले का ही मामला तेलंगाना का भी है। . पिछले वर्ष ही नवंबर में तेलंगाना में हुए चुनाव में बीआरएस के मुखिया व राज्य मतदात या के तत्कालीन मुख्यमंत्री के. चंद्रशेखर राव गया। ही का डीपफेक वीडियो बन गया, जिसमें राव बाइड वैनी कांग्रेस के पक्ष में वोट करने के लिए कह किन रहे थे। बीआरएस की तरफ से चुनाव ने के दौरान उनके खिलाफ डीपफेक के रूप इस्तेमाल को लेकर पुलिस में शिकायत चिक भी दर्ज कराई गई थी। इसके अलावा गत टना नवंबर में राजस्थान में चुनाव के दौरान जारी यह है में अ या मय मतदाताओं को रिझाने के लिए एआइ के – है। का इस्तेमाल कर पूर्व मुख्यमंत्री अशोक एक हुए गहलोत की आवाज में वाट्सअप से मतदाताओं को उनके नाम से काल किया – राव गया। हाल ही में अमेरिका के राष्ट्रपति जो पहल उस जान -राव बाइडन की नकली आवाज में एक वीडियो से कह जारी किया गया। इन घटनाओं का इशारा यह है कि देश से लेकर विदेश तक चुनाव नह के में अपने विरोधियों को नुकसान पहुंचाने वी कायत या खुद के पक्ष में वोटरों को रिझाने की गत मंशा से डीपफेक का इस्तेमाल तेजी से प दौरान शुरू हो गया है। पिछले दो साल से दुनिया क एआइ के विभिन्न देशों में होने वाले चुनावों में बशोक एआइ आधारित डीपफेक के इस्तेमाल की प से घटनाएं सामने आ रही हैं। दुनिया के सबसे बड़े लोकतंत्र के चुनाव को डीपफेक से अछूता रखना संभव नहीं दिख रहा है, क्योंकि चुनाव एक धारणा और उम्मीदवार की छवि पर लड़ा जाता है और डीपफेक दोनों ही चीजों को तहस- नहस करने की क्षमता रखता है। भारत में जहां 90 करोड़ से अधिक मतदाता हैं और लगभग सभी मतदाता इंटरनेट से लैस मोबाइल फोन रखते हैं। ऐसे में किसी उम्मीद्ववार की छवि को नुकसान पहुंचाने वाला डीपफेक वीडियो चुनाव के दिन या मतदान होने से कुछ घंटे पहले प्रसारित हो जाए तो निश्चित रूप से उस उम्मीदवार को क्षति हो सकती है। जानकार कहते हैं कि इस तरह के वीडियो से अगर एक भी वोट प्रभावित होता है तो निश्चित रूप से यह लोकतंत्र के लिए शुभ नहीं है। जानकारों के मुताबिक, डीपफेक वीडियो या आडियो के लिए ऐसे लोगों का इस्तेमाल किया जाता है, जिनका कोई पब्लिक प्रोफाइल नहीं होता है। उनके नंबर का इस्तेमाल वाट्सएप या अन्य प्लेटफार्म पर किया जाता है। इस वजह से डीपफेक वीडियो फैलाने वाले के बारे में जल्दी से पता नहीं चल पाता है।

वास्तव में होता क्या है डीपफेक ?

आपको बता दें कि डीपफेक वीडियो और वीडियो दोनों रूप में हो सकता है। इसे एक स्पेशल मशीन लर्निंग का इस्तेमाल करके बनाया जाता है जिसे डीप लर्निंग कहा जाता है। डीप लर्निंग में कंप्यूटर को दो वीडियोज या फोटो दिए जाते हैं जिन्हें देखकर वह खुद ही दोनों वीडियो या फोटो को एक ही जैसा बनाता है। यह ठीक उसी तरह है जैसे बच्चा किसी चीज की नकल करता है। इस तरह के फोटो वीडियोज में हिडेन लेयर्स होते हैं जिन्हें सिर्फ एडिटिंग सॉफ्टवेयर से ही देखा जाता है। एक लाइन में कहें तो डीपफेक, रियल इमेज-वीडियोज को बेहतर रियल फेक फोटो-वीडियोज में बदलने की एक प्रक्रिया है। डीपफेक फोटो-वीडियोज फेक होते हुए भी रियल नजर आते हैं। बहुत ही आसान भाषा में कहें तो डीपफेक एक एडिटेड वीडियो होता है जिसमें किसी अन्य के चेहरे को किसी अन्य के चेहरे से बदल दिया जाता है। डीपफेक वीडियोज इतने सटीक होते हैं कि आप इन्हें आसानी से पहचान नहीं सकते। डीपफेक वीडियो बनाने के लिए आर्टिफिशियल इंटेलिजेंस (AI) और मशीन लर्निंग की भी मदद ली जाती है।

AI Deepfake

कैसे तैैयार होता है डीपफेक

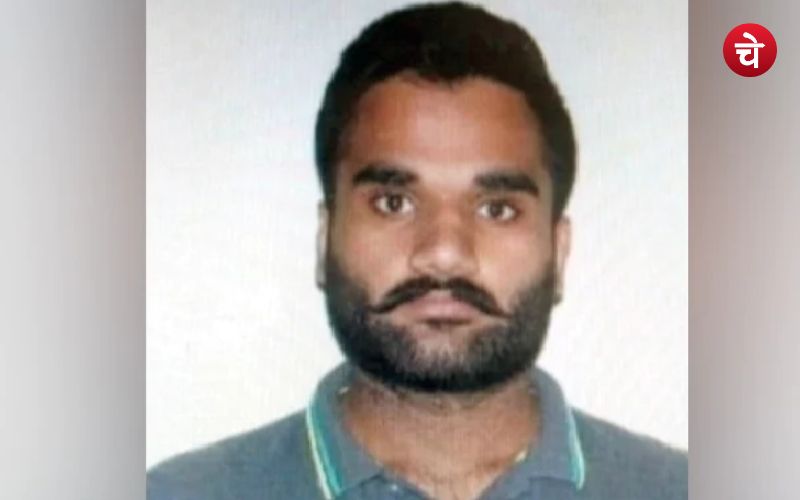

Deepfakes दो नेटवर्क की मदद से बनता है जिनमें एक इनकोडर होता है और दूसरा डीकोडर नेटवर्क होता है। इनकोडर नेटवर्क सोर्स कंटेंट (असली वीडियो) को एनालाइज करता है और फिर डाटा को डीकोडर नेटवर्क को भेजता है। उसके बाद फाइनल आउटपुट निकलता है जो कि हूबहू असली जैसा है लेकिन वास्तव में वह फेक होता है। इसके लिए सिर्फ एक वीडियो या वीडियो की जरूरत होती है। डीपफेक के लिए कई वेबसाइट्स और एप हैं जहां लोग डीपफेक वीडियोज बना रहे हैं। आप ऊपर की तस्वीर को देखें। ना यह इंस्टाग्राम अकाउंट ऐश्वर्या राय बच्चन का है और ना इस पर शेयर हुए कंटेंटऐश्वर्या राय के हैं। यह डीपफेक का सबसे बड़ा उदाहरण है। इस तरह के फोटो-वीडियोज को पहचानना आसान तो नहीं है लेकिन नामुमकिन भी नहीं है। इन्हें पहचानने के लिए आपको वीडियो को बहुत ही बारिकी से देखना होगा। खासतौर पर चेहरे के एक्सप्रेशन, आंखों की मूवमेंट और बॉडी स्टाइल पर ध्यान देना होगा। इसके अलावा बॉडी कलर से भी आप इन्हें पहचान सकते हैं। आमतौर पर ऐसे वीडियोज में चेहरे और बॉडी का कलर मैच नहीं करता है। इसके अलावा लिप सिंकिंग से भी इस तरह के वीडियोज की पहचान की जा सकती है। ऐसे वीडियोज को आप लोकेशन और एक्स्ट्रा ब्राइटनेस से भी पहचान सकते हैं। इसके अलावा खुद की समझ से भी आप यह तय कर सकते हैं कि यह वीडियो असली है या नहीं। अब आप डीपफेक नामक इस नई बीमारी को ठीक से समझ गए होंगे। तो पूरी तरह आप भी सावधान रहें डीपफेक की इस बीमारी से। AI Deepfake

बहुबली पूर्व विधायक मुखतार अंसारी को मिली उम्रकैद, कोर्ट ने सुनाया फैसला

ग्रेटर नोएडा – नोएडा की खबरों से अपडेट रहने के लिए चेतना मंच से जुड़े रहें।

देश–दुनिया की लेटेस्ट खबरों से अपडेट रहने के लिए हमें फेसबुक पर लाइक करें या ट्विटर पर फॉलो करें